Warum KI eigentlich kaum etwas versteht

- max planck institut

- leiter des kausalen verstädnnisses

- kausalität

- Künstliche Intelligenz

- machine learning

- intelligente systeme

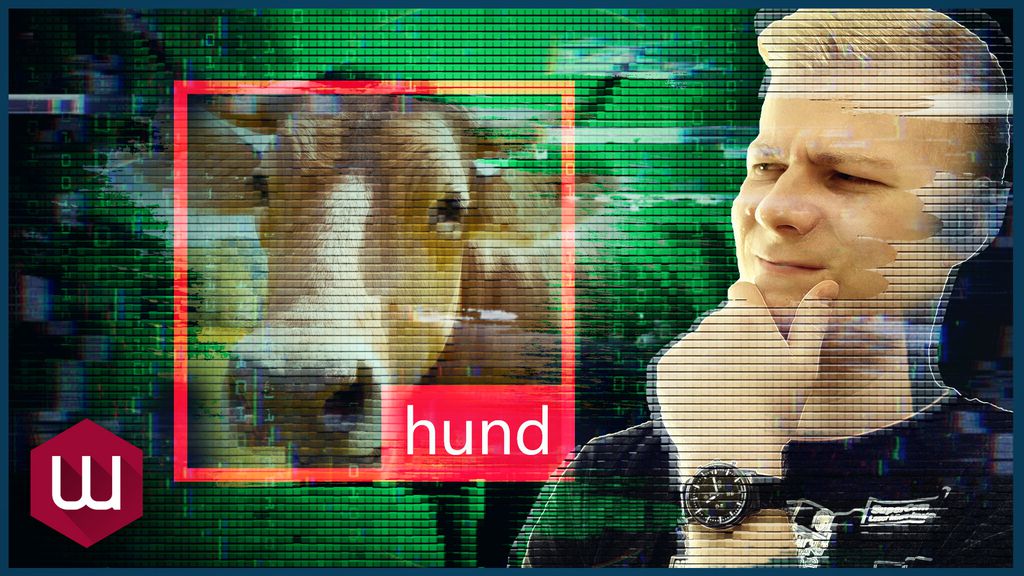

Für den zweiten Teil unserer Serie über Künstliche Intelligenz, in Zusammenarbeit mit dem Max Planck Institut für Intelligente Systeme, beschäftigen wir uns mit den Fragen: Kann künstliche Intelligenz wirklich verstehen, was eine Kuh oder ein Apfel ist? Was hat es mit der korrelation von gegessener Schokolade und gewonnen Nobelpreisen auf sich? Und in wiefern kann K.I. dafür genutzt werden, ein Strafmaß für angeklagte Personen festzulegen? Vielen Dank an das Max-Planck-Institut für Intelligente Systeme für die wunderbare Zusammenarbeit und an die Körber-Stiftung für die Unterstützung bei dieser Video-Serie. Quellen: 1 – Pearl, Judea: The Book Of Why (2018), Hernán MA, Robins JM (2020). Causal Inference: What If. Boca Raton: Chapman & Hall/CRC 2 – https://youtu.be/MFMS8P 3 – https://academic.oup.com/jn/article/143/6/931/4571741 4 – https://blogs.scientificamerican.com/the-curious-wavefunction/chocolate-consumption-and-nobel-prizes-a-bizarre-juxtaposition-if-there-ever-was-one/ 5 – https://www.bpb.de/internationales/weltweit/megastaedte/64733/hdi 6 – https://youtu.be/dFp2Ou52-po 7 – https://www.newsobserver.com/news/business/article182937786.html 8 – https://www.washingtonpost.com/business/2019/11/19/algorithms-were-supposed-make-virginia-judges-more-fair-what-actually-happened-was-far-more-complicated/ 9 – https://www.technologyreview.com/2019/01/21/137783/algorithms-criminal-justice-ai/ 10 – https://papers.ssrn.com/sol3/papers.cfm?abstract_id=3489440 11 – https://poseidon01.ssrn.com/delivery.php?ID=150124106095080126025081122092096022063075036012049018106112004097090095113093027067123121063030017007034091087122123120026098020040034053046097081067031123064082119028069037067108072125006126118094004010025117101104118095123074105087085106075093008110&EXT=pdf&INDEX=TRUE S.28/29 12 – https://ieeexplore.ieee.org/abstract/document/6472238?casa_token=0K9P6sr8jPQAAAAA:gXd2kaAfOwmov-pJqINd7CjqAPHSlydkK52pZbXlCkpgDUjL3fTWdvNZpFqKQSJHCSQXdtuG8HA 13 – Pearl, Judea: The Book Of Why (2018), Schölkopf, Janzing, Peters: Causal Inference 14 – https://towardsdatascience.com/why-robustness-is-not-enough-for-safety-and-security-in-machine-learning-1a35f6706601 , https://towardsdatascience.com/the-robustness-of-machine-learning-algorithms-against-missing-or-abnormal-values-ec3222379905 15 – https://arxiv.org/abs/2106.16091 16 – https://ieeexplore.ieee.org/stamp/stamp.jsp?arnumber=9363924